Материалы по тегу: периферийные вычисления

|

29.02.2024 [14:13], Сергей Карасёв

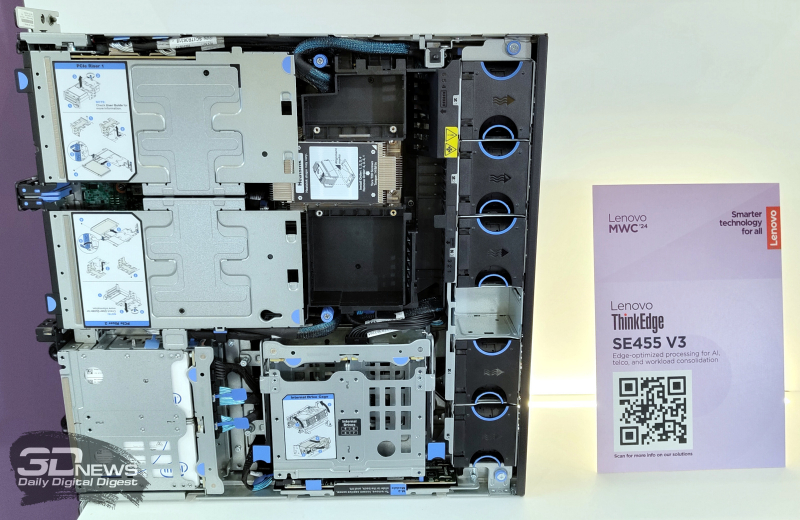

Lenovo представила обновлённые серверы ThinkEdge для ИИ-задач и периферийных вычисленийКомпания Lenovo на выставке MWC 2024 анонсировала новые серверы, предназначенные для решения ИИ-задач и организации периферийных вычислений. Демонстрируются модели ThinkEdge SE455 V3, ThinkEdge SE350 V2 и ThinkEdge SE360 V2. Первая из перечисленных новинок построена на платформе AMD EPYC 8004 Siena с возможностью установки одного процессора с показателем TDP до 225 Вт. Устройство выполнено в формате 2U с глубиной 438 мм. Есть шесть слотов для модулей DDR5-4800, по четыре внешних и внутренних отсека для накопителей SFF (SATA или NVMe). Доступны до шести слотов PCIe — 2 × PCIe 5.0 x16 и 4 × PCIe 4.0 x8. Предусмотрены также два коннектора для SSD типоразмера M.2. Серверы ThinkEdge SE350 V2 и ThinkEdge SE360 V2 выполнены в формате 1U и 2U соответственно. Они рассчитаны на установку одного процессора Intel Xeon D-2700 с TDP до 100 Вт. Первая из этих моделей позволяет задействовать до четырёх SFF-накопителей NVMe/SATA толщиной 7 мм и два SFF-устройства NVMe толщиной 15 мм. Слоты расширения PCIe не предусмотрены. Второй сервер может быть оборудован двум SFF-накопителями NVMe/SATA толщиной 7 мм и восемью устройствами M.2 2280/22110 (NVMe). Имеются два слота PCIe 4.0 x16. Представлены также компьютеры небольшого форм-фактора ThinkEdge SE10 и ThinkEdge SE30 для промышленной автоматизации, IoT-приложений и пр. Эти устройства оснащаются процессорами Intel — вплоть до Atom x6425RE и Core i5-1145GRE соответственно. Первый из этих компьютеров может быть оснащён одним накопителем M.2 PCIe SSD вместимостью до 1 Тбайт, второй — двумя. Ребристая поверхность корпуса выполняет функции радиатора для отвода тепла.

29.02.2024 [12:17], Сергей Карасёв

Iceotope, HPE и Intel представили сервер KUL RAN второго поколения с СЖОКомпании Iceotope, HPE и Intel продемонстрировали на MWC 2024 ряд новинок для телекоммуникационной отрасли и edge-приложений. В частности, представлен сервер KUL RAN второго поколения с эффективной системой жидкостного охлаждения. Edge-сервер KUL RAN первого поколения дебютировал в июне 2023 года. Он предназначен для развёртывания vRAN-платформ, сетей 5G и других сервисов связи. Применена полностью автономная СЖО Iceotope Precision Liquid Cooling. Новая модель KUL RAN выполнена в форм-факторе 2U. В основу положен сервер HPE ProLiant DL110 Gen11 на базе Intel Xeon Sapphire Rapids. Iceotope заявляет, что устройство может эксплуатироваться в «самых суровых условиях». Оно имеет защиту от тепловых ударов, пыли и влаги. Диапазон рабочих температур простирается от -40 до +55 °C. Утверждается, что решение обеспечивает сокращение энергопотребления до 20 % по сравнению со стандартными телеком-серверами, тогда как частота отказов компонентов ниже на 30 %. Устройство KUL RAN второго поколения ориентировано на сети радиодоступа с низкими задержками и edge-задачи. Iceotope также заявляет, что её технология Precision Liquid Cooling даёт возможность охлаждать процессоры с показателем TDP 1000 Вт и даже выше. Таким образом, система подходит для применения в мощных ИИ-серверах с высокой нагрузкой.

НРЕ показала на MWC 2024 и другие системы для телекоммуникационной отрасли и инфраструктур связи 5G. Это, в частности, сервер ProLiant RL300 Gen11 со 128-ядерным Arm-чипом Ampere. Устройство типоразмера 1U оборудовано десятью фронтальными отсеками для SFF NVMe SSD с интерфейсом PCIe 4.0, тремя слотами расширения PCIe 4.0 и двумя слотами OCP 3.0.

27.02.2024 [16:08], Сергей Карасёв

Supermicro анонсировала ИИ- и телеком-серверы на базе AMD EPYC Siena, Intel Xeon Emerald Rapids и NVIDIA Grace Hopper

5g

amd

emerald rapids

epyc

gh200

grace

hardware

intel

mwc 2024

nvidia

siena

supermicro

ии

периферийные вычисления

сервер

Компания Supermicro представила на выставке мобильной индустрии MWC 2024 в Барселоне (Испания) новые серверы для телекоммуникационной отрасли, 5G-инфраструктур, задач ИИ и периферийных вычислений. Дебютировали модели с процессорами AMD EPYC 8004 Siena, Intel Xeon Emerald Rapids и с суперчипами NVIDIA GH200 Grace Hopper. В частности, анонсирована стоечная система ARS-111GL-NHR высокой плотности в форм-факторе 1U на базе GH200. Устройство наделено двумя слотами PCIe 5.0 x16, восемью фронтальными отсеками для накопителей E1.S NVMe и двумя коннекторами для модулей M.2 NVMe. Сервер предназначен для работы с генеративным ИИ и большими языковыми моделями (LLM). На периферийные 5G-платформы ориентировано решение SYS-211E ультрамалой глубины — 298,8 мм. Модель рассчитана на один процессор Xeon Emerald Rapids в исполнении LGA-4677. Есть восемь слотов для модулей DDR5-5600 общей ёмкостью до 2 Тбайт и до шести слотов PCIe 5.0 в различных конфигурациях для карт расширения. Модификация SYS-211E-FRDN13P для сетей Open RAN предлагает 12 портов 25GbE и поддерживает технологию Intel vRAN Boost. Ещё одна новинка — сервер AS-1115S-FWTRT формата 1U с возможностью установки одного процессора EPYC 8004 Siena (до 64 ядер). Реализована поддержка до 576 Гбайт памяти DDR5-4800 (шесть слотов), двух портов 10GbE, двух слотов PCIe 5.0 x16 FHFL и одного слота PCIe 5.0 x16. Решение предназначено для edge-приложений.

Представлены также многоузловая платформа SYS-211SE-31D/A и система высокой плотности SYS-221HE: обе модели выполнены в формате 2U на процессорах Xeon Emerald Rapids. Второй из этих серверов допускает монтаж до трёх двухслотовых ускорителей NVIDIA H100, A10, L40S, A40 или A2. Наконец, анонсирован сервер AS-1115SV типоразмера 1U с поддержкой процессоров EPYC 8004 Siena, 576 Гбайт памяти DDR5, трёх слотов PCIe 5.0 x16 и 10 накопителей SFF.

26.02.2024 [14:47], Сергей Карасёв

Мини-компьютер BrainChip Akida Edge AI Box оснащён двумя нейроморфными ИИ-чипами AKD1000Компания BrainChip, по сообщению ресурса CNX-Software, начала приём заказов на компьютер небольшого форм-фактора Akida Edge AI Box, разработанный в партнёрстве с VVDN Technologies. Новинка предназначена для выполнения ИИ-задач на периферии. В основу положен процессор NXP i.MX 8M Plus Quad с четырьмя ядрами Arm Cortex-A53, функционирующими на тактовой частоте до 1,8 ГГц. В состав чипа входят графические блоки Vivante GC7000UL 3D GPU и Vivante GC520L 2D GPU, а также модуль NPU с производительностью до 2,3 TOPS. В оснащение мини-ПК включены два нейроморфных чипа BrainChip Akida AKD1000 (интерфейс PCIe) с ядром реального времени Arm Cortex-M4 с тактовой частотой 300 МГц. Они предназначены для ускорения операций, связанных с ИИ и машинным обучением. Объём оперативной памяти LPDDR4 составляет 4 Гбайт. Есть флеш-модуль eMMC вместимостью 32 Гбайт, слот для карты microSD, адаптер Wi-Fi 5 (802.11n/ac; 2,4 и 5 ГГц) и двухпортовый сетевой контроллер 1GbE.

Источник изображения: BrainChip Возможно кодирование и декодирование видеоматериалов в формате 1080p60 (H.265 и H.264). Предусмотрены разъёмы USB 3.0 Type-A и USB 2.0 Micro-B. Габариты составляют 110 × 110 × 56 мм. Диапазон рабочих температур — от 0 до +50 °C. Применяется программная платформа на базе ядра Linux 6.1. Компьютер предлагается по ориентировочной цене $800.

21.02.2024 [13:50], Сергей Карасёв

Supermicro представила ИИ-серверы для периферийных вычисленийКомпания Supermicro анонсировала новые серверы, предназначенные для развёртывания ИИ-приложений на периферии. Дебютировали системы с процессорами Intel Xeon Emerald Rapids, поддерживающие установку различных ускорителей NVIDIA, включая H100. Одной из новинок стал сервер SYS-621C-TN12R семейства CloudDC, выполненный в форм-факторе 2U. Он рассчитан на установку двух чипов Xeon в исполнении Socket E (LGA-4677) с показателем TDP до 350 Вт. Доступны 16 слотов для модулей DDR5-5600 суммарным объёмом до 4 Тбайт. Для ускорителей типоразмера FHHL доступны два слота PCIe 5.0 x16. Есть 12 отсеков для LFF-накопителей NVMe/SATA/SAS и два коннектора для SSD формата M.2 2280 с интерфейсом PCIe 5.0 x4.

Источник изображений: Supermicro Представлен и 1U-сервер SYS-111E-FWTR высокой плотности. Допускается использование одного процессора Xeon в исполнении Socket E с величиной TDP до 350 Вт и восьми модулей DDR5-5600 (до 2 Тбайт). Имеются два слота PCIe 5.0 x16 FHFL, один слот PCIe 5.0 x16 LP, один коннектор M.2 22110/2280 (PCIe 3.0 x2; NVMe) и два посадочных места для SFF-накопителей с интерфейсом SATA-3. Данная модель, как отмечается, подходит для широкого спектра сетевых и периферийных приложений. Схожими характеристиками обладает компактный сервер SYS-E403-13E-FRN2T в форм-факторе блочного ПК: это устройство поддерживает монтаж трёх ускорителей PCIe 5.0 x16 FHFL. Ещё одна новинка — сервер SYS-211E-FRN2T сверхмалой глубины, составляющей 300 мм. От двух предыдущих моделей он отличается тем, что снабжён двумя коннекторами для SSD типоразмера M.2 2280/22110 (NVMe), а слоты расширения выполнены по схеме 1 × PCIe 5.0 x16 или x8 HHHL, 1 × PCIe 5.0 x8 HHHL и 2 × PCIe 5.0 x16 FHHL.  Универсальная система SYS-211SE-31D, в свою очередь, представляет собой трёхузловой сервер стандарта 2U. Каждый узел допускает установку одного чипа Xeon в исполнении Socket E, восьми модулей DDR5-5600, двух ускорителей PCIe 5.0 x16 FHHL, одной карты PCIe 5.0 x16 HHHL и двух модулей M.2 2280/22110 (NVMe). Наконец, дебютировал компактный IoT-сервер SYS-E300-13AD с поддержкой одного процессора Intel Core в исполнении LGA-1700 с величиной TDP до 65 Вт. Предусмотрены два слота для модулей памяти DDR4-3200 суммарным объёмом до 64 Гбайт, один разъём PCIe 5.0 x16 для низкопрофильной карты расширения, одно посадочное место для SFF-накопителя SATA, по одному коннектору М.2 E-Key 2230 (PCIe 3.0 x1 / USB2.0) и М.2 M-Key 2280 (PCIe 4.0 x4; NVMe). Все анонсированные серверы оборудованы воздушным охлаждением.

15.02.2024 [12:41], Сергей Карасёв

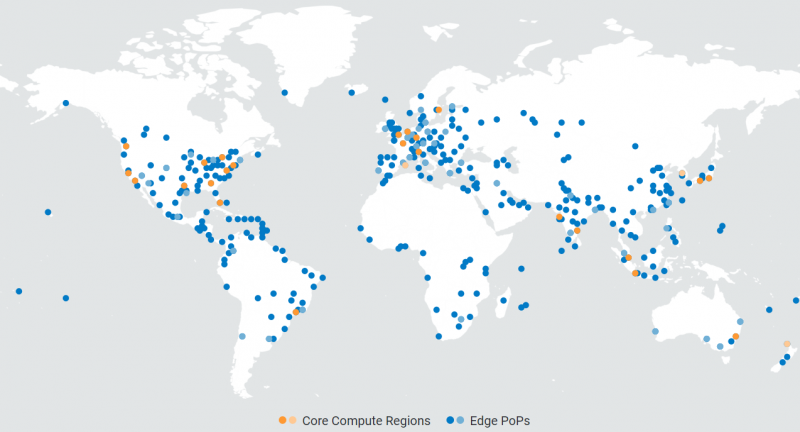

Akamai представила сервис Gecko — облачные вычисления на периферииCDN-провайдер Akamai Technologies объявил о запуске платформы Gecko (Generalized Edge Compute), которая позволяет использовать облачные вычисления на периферии. Сервис призван помочь компаниям улучшить качество обслуживания клиентов путём перемещения своих рабочих нагрузок ближе к конечным пользователям. Проект Gecko является частью стратегии Akamai по её трансформации в распределённого облачного провайдера. По сути, речь идёт о формировании альтернативной облачной инфраструктуры, отвечающей потребностям высокопроизводительных приложений — с небольшими задержками и гибкой масштабируемостью.

Источник изображения: Akamai Gecko предусматривает интеграцию облачных сервисов в развитую CDN-сеть Akamai. Отмечается, что традиционные современные архитектуры предусматривают разделение облачных и периферийных платформ. В свою очередь, Gecko переносит «тяжёлые» нагрузки, которые обычно обрабатываются в крупных дата-центрах, на периферию. Благодаря этому полнофункциональные вычисления становятся возможными в сотнях ранее недоступных локаций, что позволит клиентам переносить ресурсоёмкие приложения ближе к конечным пользователям. В начале 2023 года Akamai запустила платформу Connected Cloud на базе Linode. Она представляет собой более распределённую альтернативу сервисам AWS или Azure. Сеть Akamai насчитывает приблизительно 4100 точек присутствия по всему миру. Эта инфраструктура поможет в реализации проекта Gecko. Платформа Gecko будет развёрнута три этапа. На первом планируется внедрении вычислений с поддержкой виртуальных машин в 100 городах к концу 2024 года. На данный момент компания уже развернула регионы Gecko в таких местах, как Гонконг, Куала-Лумпур (Малайзия), Керетаро (Мексика), Йоханнесбург (Южная Африка), Богота (Колумбия), Денвер (Колорадо), Хьюстон (Техас), Гамбург (Германия) и Марсель (Франция). В конечном итоге Akamai намерена распространить Gecko на сотни городов по всему миру. Вторая фаза Gecko начнётся позднее в нынешнем году, когда Akamai добавит поддержку контейнеров. На третьем этапе будет реализована поддержка автоматизированной оркестрации рабочих нагрузок, что позволит разработчикам развёртывать распределённые высокопроизводительные приложения. Среди ключевых рабочих нагрузок для Gecko названы ИИ, многопользовательские игры, а также социальные сети и потоковая передача мультимедийных материалов. Сеть также может использоваться для таких задач, как иммерсивная розничная торговля, пространственные вычисления, потребительский и промышленный Интернет вещей.

24.01.2024 [14:50], Руслан Авдеев

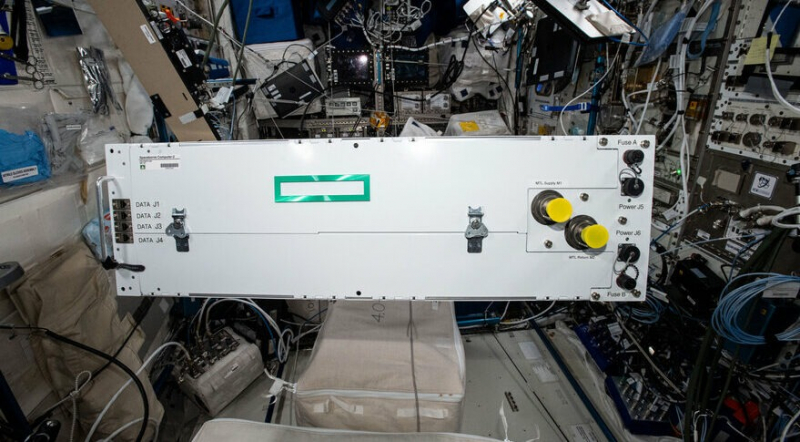

Обновлённый космический суперкомпьютер HPE Spaceborne-2 готов к отправке на МКСНа следующей неделе планируется запуск на Международную космическую станцию (МКС) обновлённого варианта специального вычислительного модуля HPE Spaceborne Computer-2. Как сообщает Национальная лаборатория МКС, это коммерческая версия суперкомпьютера из серийных компонентов, созданная на основе серверов семейств HPE EdgeLine и ProLiant. Организаторами запуска выступают NASA, Northrop Grumman и SpaceX. Старт должен состояться 29 января 2024 года в рамках миссии NG-20 — борту корабля Northrop Grumman Cygnus планируется доставить на станцию различные научные материалы, оборудование и компоненты. Одним из грузов будет и обновлённая версия Spaceborne-2, ранее отправленного на МКС в феврале 2021 года и вернувшегося на Землю 11 января 2023. Первый компьютер серии Spaceborne отправили на МКС 14 августа 2017 года, возвращение состоялось 4 июня 2019.

Источник изображения: NASA По данным Datacenter Dynamics, в состав системы всё ещё входят x86-серверы HPE Edgeline EL4000 с одним GPU и HPE DL360 Gen10. Обновлённая система протестирована HPE и передана NASA. Всего по требованию NASA пришлось внести 516 корректировок. Например, HPE в сотрудничестве с KIOXIA оснастила систему дополнительным хранилищем. Суперкомпьютер поможет продолжающимся на МКС исследованиям, обеспечив более быструю обработку наблюдений со станции за Землёй и более эффективный мониторинг здоровья астронавтов.

10.01.2024 [19:40], Сергей Карасёв

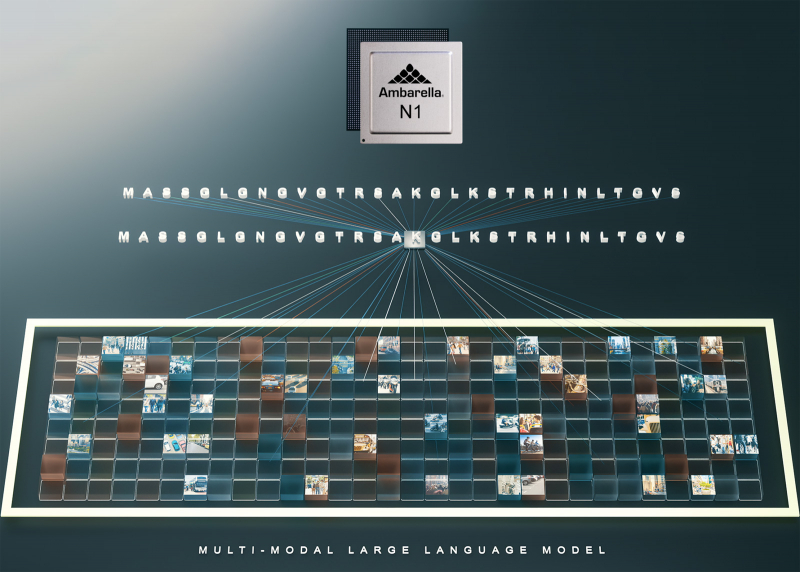

Новые чипы Ambarella привнесут возможности генеративного ИИ в периферийные устройстваКомпания Ambarella сообщила о том, что её SoC обеспечат поддержку генеративного ИИ на периферии. Ожидается, что это позволит расширить возможности множества систем и приложений, включая робототехнику и средства видеоаналитики. Отмечается, что по сравнению с ускорителями на базе GPU и другими специализированными решениями, чипы Ambarella представляют собой полноценные «системы на чипе», которые обеспечивают до трёх раз более высокую энергоэффективность на каждый токен. Изначально Ambarella обеспечит оптимизированные возможности генеративного ИИ на своих SoC среднего и высокого классов. Это, в частности, изделие CV72 для устройств с энергопотреблением до 5 Вт. Кроме того, функции генеративного ИИ будут поддерживать чипы новой серии N1 с «производительностью серверного уровня» при энергопотреблении до 50 Вт. Чипы N1 основаны на архитектуре Ambarella CV3-HD, изначально разработанной для приложений автономного вождения. Утверждается, что изделие N1 способно обрабатывать модель Llama2-13B с выводом до 25 токенов в секунду в однопоточном режиме при потребляемой мощности менее 50 Вт. Все изделия Ambarella используют новую платформу для разработчиков Cooper. Чтобы ускорить вывод конечных продуктов на рынок, Ambarella предварительно портировала и оптимизировала популярные большие языковые модели, такие как Llama-2 и LLava.

24.12.2023 [00:14], Руслан Авдеев

Семь компаний из Нидерландов присоединились к проекту ЕС по созданию энергоэффективных периферийных ЦОД

asperitas

hardware

евросоюз

нидерланды

периферийные вычисления

разработка

цод

экология

энергоэффективность

Консорциум, объединяющий семь нидерландских компаний и исследовательских структур выиграл грант на проект, предусматривающий создание эффективных ЦОД для периферийных вычислений. Как сообщает Datacenter Dynamics, т.н. Modular Integrated Sustainable Datacenter project (MISD) получил «зелёный свет» у чиновников Евросоюза и Министерства экономики и климата Нидерландов. По имеющимся данным, проект получит €70 млн от местного правительства. В консорциум входят специалист по системам жидкостного охлаждения — компания Asperitas, а также BetterBe, Deerns, Eurofiber, NBIP (National Internet Providers Management Organization), TNO и Университет Твенте. Проект MISD стал частью программы European IPCEI (Important Project of Common European Interest – Cloud Infrastructure and Services), которая получит €1,2 млрд на разработку общей облачной инфраструктуры Евросоюза. В 2024–2029 гг. в рамках MISD необходимо будет построить модульный, экоустойчивый, безопасный ЦОД для периферийных вычислений. При этом выбросы углекислого газа необходимо снизить вдвое в сравнении с предлагаемыми сегодня решениями.

Источник изображения: Callum Parker/unsplash.com Как заявляют в Asperitas, MISD стал плодом многолетнего сотрудничества, направленного на создание энергетически эффективных ЦОД. Ожидается, что выделение средств позволит стране стать хабом для разработки дата-центров нового поколения. Сама Asperitas обеспечивает системы иммерсионного охлаждения, BetterBe является SaaS-провайдером, Deerns представляет собой инженерную компанию. Наконец, Eurofiber — это провайдер оптических сетей. В Asperitas намерены добиться «оптимальных результатов» от применения жидкостного охлаждения, а в BetterBe заявили, что намерены внести вклад в разработку и реализацию модульных энергосберегающих дата-центров с распределёнными облачными платформами и изучить возможности более оптимального использования аппаратного обеспечения. Eurofiber обеспечит лабораторию и географически распределённую среду для испытаний, а NBIP будет изучать возможности повышения безопасности и доступности новой облачной инфраструктуры, например, с помощью распределённой защиты от DDoS-атак.

18.12.2023 [13:14], Сергей Карасёв

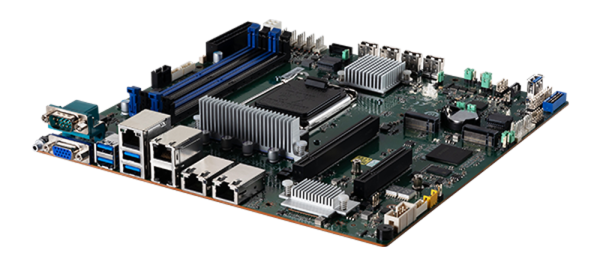

MSI представила серверы начального уровня на процессорах Intel Xeon E-2400Компания MSI анонсировала свои первые продукты, поддерживающие процессоры Intel Xeon E-2400. Дебютировали материнская плата D1500, а также серверы S1103 и E2103, предназначенные для сферы малого и среднего бизнеса, периферийных вычислений и пр. Новинки относятся к начальному уровню.

Источник изображений: MSI Плата D1500 выполнена в форм-факторе micro-ATX. Поддерживается установка чипа в исполнении LGA 1700: напомним, изделия Xeon E-2400 содержат до восьми ядер Raptor Cove, имеют два канала памяти DDR5 и позволяют использовать до 16 линий PCIe 5.0. Величина TDP не превышает 95 Вт. Материнская плата наделена четырьмя слотами для ОЗУ-модулей DDR5-4800 UDIMM и двумя разъёмами PCIe. Поддерживаются до восьми портов SATA-3; кроме того, можно установить два SSD формата М.2 2280/22110 (NVMe). В оснащение также включён двухпортовый сетевой контроллер 10GbE.

Источник изображений: MSI Модель D1500 является основой стоечных серверов S1103 и E2103 типоразмера 1U и 2U соответственно. Первый из них допускает установку четырёх LFF-накопителей и двух внутренних SFF-устройств (все с интерфейсом SATA-3). Этот экономичный сервер хорошо подходит для таких задач, как веб-хостинг, периферийные вычисления, облачные приложения, хранение данных и пр. В свою очередь, E2103 представляет собой edge-сервер стандарта 2U, оборудованный одним слотом PCIe 5.0 и двумя коннекторами M.2 NVMe. Во фронтальной части располагаются шесть отсеков для SFF-накопителей SATA. В качестве опции предлагается возможность установки четырёх устройств U.2 NVMe. |

|